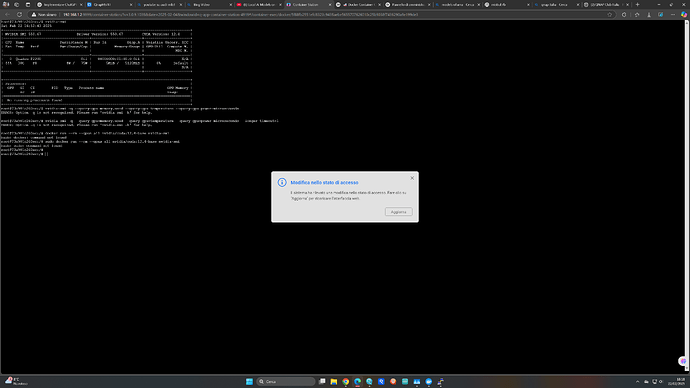

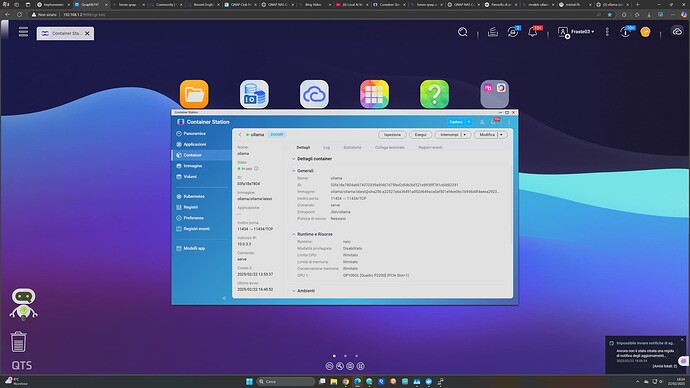

Halo teman-teman, saya telah mengonfigurasi Ollama dan WebUI dengan sempurna melalui docker di container station, tetapi saya sama sekali tidak bisa menggunakan GPU untuk kekuatan perhitungan. Saya telah mengunduh model-model sederhana sehingga Quadro P2200 saya seharusnya benar-benar mampu menanganinya. Saya sudah mengaktifkan passtrough GPU dengan sempurna dan telah menetapkannya ke container station. GPU juga sudah ditetapkan ke docker Ollama dan dari perintah MSI terlihat bahwa GPU dikenali dengan sempurna oleh docker serta driver dan CUDA telah terpasang dengan benar, tetapi saya tetap tidak bisa membuatnya bekerja dengan model-model Ollama.

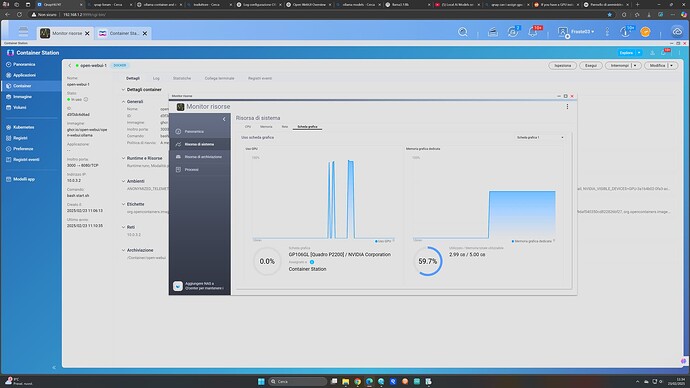

ok saya akan menjawab sendiri, ternyata cukup dengan mendedikasikan GPU juga ke container Web UI selain mendedikasikannya ke container Ollama, semoga ini membantu orang lain

saya memposting gambar di sini untuk mengonfirmasi bahwa web ui menggunakan gpu untuk mentranskode chat

tautan gambar Anda rusak

oke, kamu benar, coba sekarang

Hai fraste03, bisakah kamu memberi saya beberapa saran tentang cara menginstal ollame dan open-webui. Saya umumnya tahu cara menginstal container, tetapi bagaimana cara membuatnya bekerja seperti seharusnya…

terima kasih