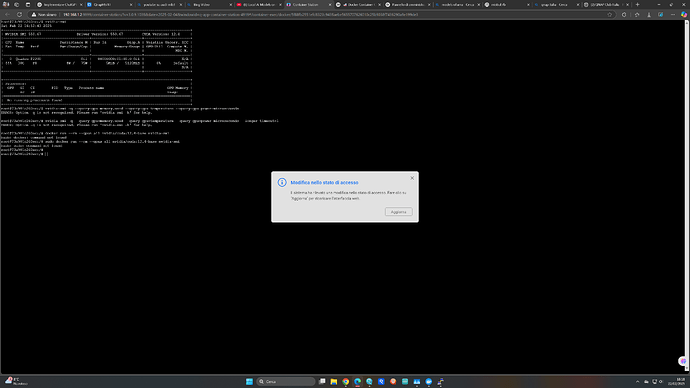

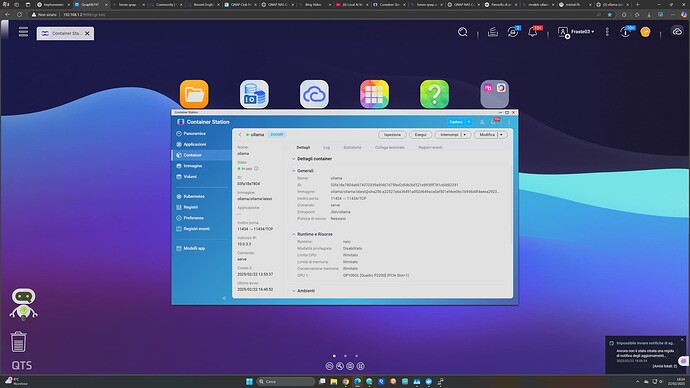

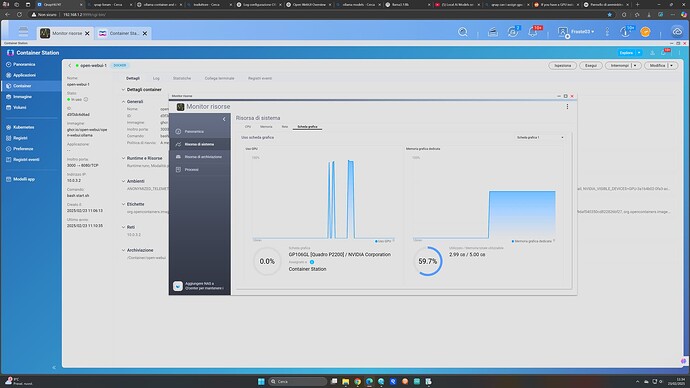

大家好,我已經通過 docker 在 Container Station 完美配置了 Ollama 和 WebUI,但無論如何都無法使用 GPU 來進行運算加速。我下載的是簡單的模型,所以我的 Quadro P2200 應該完全能夠處理這些模型。我已經正確啟用了 GPU 的直通(passthrough),並且已將其分配給 Container Station。GPU 也已分配給 Ollama 的 docker,從 MSI 指令可以看到 docker 完美識別了 GPU,驅動和 CUDA 也都安裝正確,但我無論如何都無法讓 Ollama 的模型使用 GPU 運算。