嗨,

我正在嘗試在我的 NAS(TS-433)上獲得高順序資料吞吐量,用於影片剪輯和娛樂。我所有操作都是用 Windows 檔案複製。產品頁面顯示,使用 4 顆 SSD、RAID 5 配置時,讀取速度可達 280 MB/s,寫入速度可達 202 MB/s。

這算是腦力激盪,歡迎大家回饋!

如果可以的話,請大家分享一下自己的效能表現和磁碟配置?

我是在真正研究之前就買了 NAS/硬碟。我不想丟掉或賣掉現有設備,也許加點東西提升效能或微調設定,至少要搞懂現狀。這是我的目標。

我的設定

TS-433 Qnap v5.2.3.3006(2025 年 1 月 8 日)

2x Seagate 4TB IronWolf,RAID 1(鏡像)

2.5 Gbit 網路,客戶端與 NAS 都支援

客戶端是高階機型,配備 NVMe 儲存

剛買 NAS 的前幾天,寫入資料感覺比較快……但現在已經存了約 2TB 資料,感覺變慢了(這也合理)。

目前測試結果

從 NAS 複製檔案,平均 155 MB/s,偶爾飆到 175 MB/s。

複製檔案到 NAS,平均 80 MB/s,沒有飆高(起初 1 秒較快)。

我想了解為什麼會有這種速度,瓶頸在哪裡。

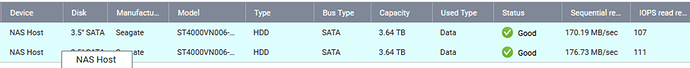

磁碟效能

Qnap 軟體顯示的磁碟吞吐量:

透過 CLI 用一些舊指令測試:

$ hdparm -t /dev/sda -t /dev/sdb -t /dev/md1

/dev/sda:

緩衝磁碟讀取:608 MB,3.01 秒 = 202.32 MB/sec

/dev/sdb:

緩衝磁碟讀取:592 MB,3.01 秒 = 196.79 MB/sec

/dev/md1:

緩衝磁碟讀取:802 MB,3.02 秒 = 265.61 MB/sec

$ echo 3 > /proc/sys/vm/drop_caches && dd if=/dev/sda of=/dev/null bs=1M count=4000

4000+0 records in

4000+0 records out

4194304000 bytes (3.9GB) copied, 20.796743 seconds, 192.3MB/s

$ echo 3 > /proc/sys/vm/drop_caches && dd if=/dev/sdb of=/dev/null bs=1M count=4000

4000+0 records in

4000+0 records out

4194304000 bytes (3.9GB) copied, 21.137790 seconds, 189.2MB/s

$ echo 3 > /proc/sys/vm/drop_caches && dd if=/dev/md1 of=/dev/null bs=1M count=4000

4000+0 records in

4000+0 records out

4194304000 bytes (3.9GB) copied, 18.758039 seconds, 213.2MB/s

硬碟是 5400 RPM,原本預期值會更低。

但這個網站 UserBenchmark: Seagate IronWolf 4TB (2016) ST4000VN008

顯示硬碟表現還不錯。

但 RAID 裝置(md1)比預期慢。為什麼不是 350 MB/s……

執行 “dd” 時我用 iostats 檢查磁碟:

extended device statistics

device mgr/s mgw/s r/s w/s kr/s kw/s size queue wait svc_t %b

sda 1 1 224.9 4.0 113348.4 7.0 495.2 5.6 23.3 4.2 97

sdb 1 1 220.9 4.0 111802.8 7.0 497.1 5.1 21.8 4.1 92

md1 0 0 445.8 3.0 224636.0 6.0 500.5 10.1 22.6 2.2 100

extended device statistics

device mgr/s mgw/s r/s w/s kr/s kw/s size queue wait svc_t %b

sda 0 0 241.4 0.5 121807.5 0.0 503.6 4.2 17.6 3.7 90

sdb 0 0 240.4 0.5 121807.5 0.0 505.6 4.5 18.6 3.8 92

md1 0 0 477.3 0.0 241061.3 0.0 505.0 8.8 18.5 2.1 100

extended device statistics

device mgr/s mgw/s r/s w/s kr/s kw/s size queue wait svc_t %b

sda 0 529 224.5 9.0 113152.0 2129.8 493.7 5.2 21.4 3.9 91

sdb 1 529 222.5 9.5 111362.0 2139.8 489.2 5.6 23.1 4.2 97

md1 0 0 449.0 0.0 225280.0 0.0 501.7 9.8 21.8 2.2 100

我看到鏡像是平均分配到兩顆硬碟。

網路吞吐量

我安裝了 iperf。參考 https://www.qnap.com/en/how-to/faq/article/how-do-i-install-iperf3-in-qts-and-quts-hero

C:\iperf>iperf3.exe -c qnap

Connecting to host qnap, port 5201

[ 5] local 192.168.178.174 port 59051 connected to 192.168.178.190 port 5201

[ ID] Interval Transfer Bitrate

[ 5] 0.00-1.01 sec 282 MBytes 2.34 Gbits/sec

[ 5] 1.01-2.01 sec 282 MBytes 2.37 Gbits/sec

[ 5] 2.01-3.01 sec 284 MBytes 2.37 Gbits/sec

[ 5] 3.01-4.01 sec 282 MBytes 2.37 Gbits/sec

[ 5] 4.01-5.01 sec 282 MBytes 2.36 Gbits/sec

[ 5] 5.01-6.01 sec 282 MBytes 2.37 Gbits/sec

[ 5] 6.01-7.01 sec 279 MBytes 2.34 Gbits/sec

[ 5] 7.01-8.01 sec 283 MBytes 2.37 Gbits/sec

[ 5] 8.01-9.01 sec 283 MBytes 2.36 Gbits/sec

[ 5] 9.01-10.01 sec 279 MBytes 2.35 Gbits/sec

- - - - - - - - - - - - - - - - - - - - - - - - -

[ ID] Interval Transfer Bitrate

[ 5] 0.00-10.01 sec 2.75 GBytes 2.36 Gbits/sec sender

[ 5] 0.00-10.04 sec 2.75 GBytes 2.36 Gbits/sec receiver

iperf Done.

看起來很不錯!網路沒問題。這是 NAS 傳送到客戶端。

NAS 設定

兩顆硬碟 RAID1。鏡像沒有 bitmap。

磁碟設定為一個 thick 類型邏輯磁區,沒有快照。

所以速度損失在哪?

網路效能看起來沒問題。單顆硬碟吞吐量也不錯,但 RAID 合併後沒有達到預期的提升。原因不明。也許資料到達時 ARM CPU 沒準備好?也許 CPU 忙著處理網卡和磁碟讀取?中斷等等。

哪些設定可以改善?

- SMB 多通道(SMB multichannel)

- Jumbo MTU

- SMB v3

- SMB 非同步(SMB Async)

我猜 Jumbo frames 最有感……會測試看看。

敬祝安好,

Harry